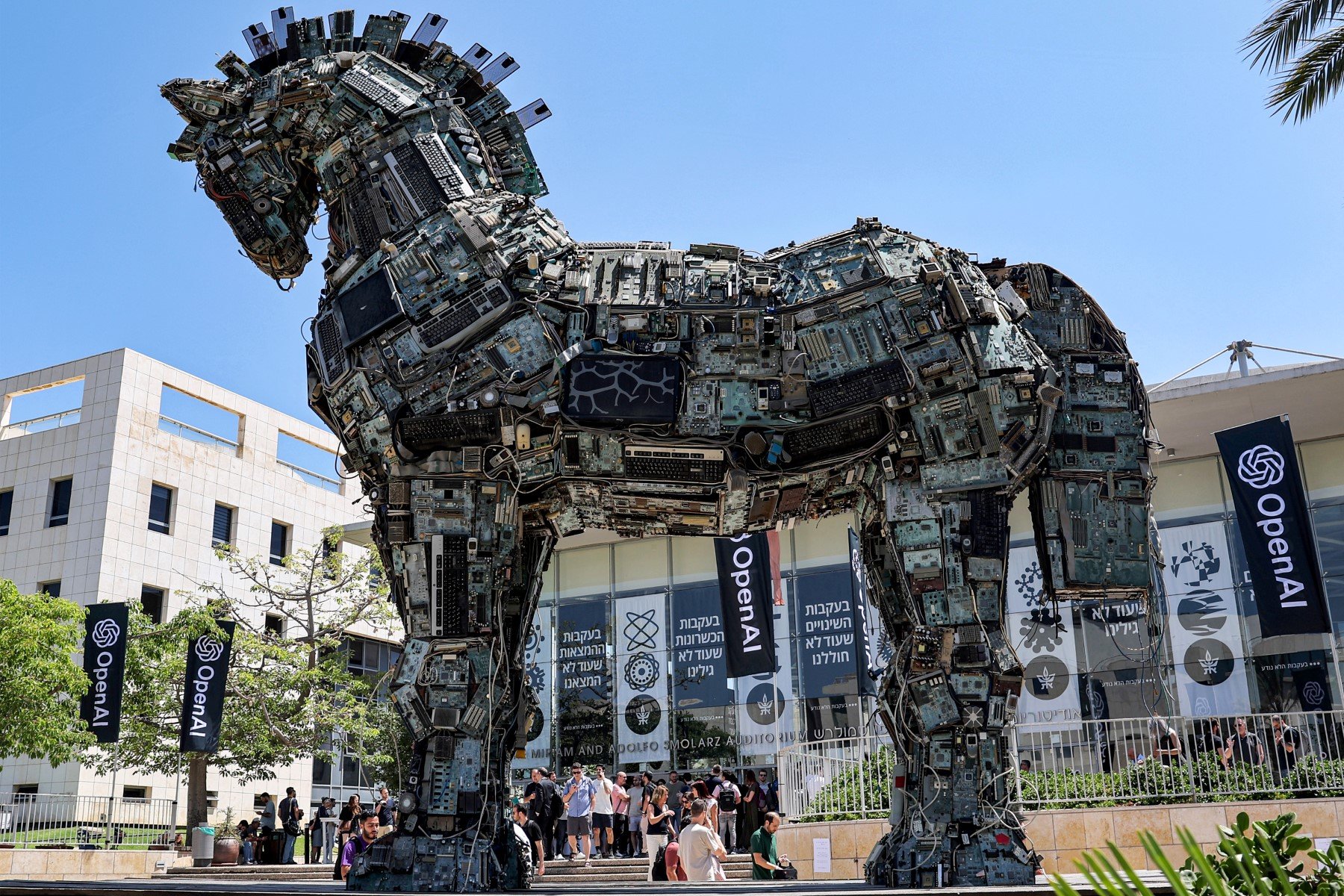

W połowie maja Sam Altman (szef #OpenAI) przekonywał komisję Senatu USA, że AI jest potencjalnie niebezpieczna i wymaga silnych regulacji. W tym samym czasie firma po cichu lobbowała w UE, by jej produkty nie były uwzględnione w kategorii wysokiego ryzyka w #AIAct.

Tydzień po zeznaniach w amerykańskim Senacie, szef OpenAI przekonywał, że „oddanie ChatGPT4 na wczesnym etapie w ręce społeczeństwa ma sens, bo pomaga zauważyć błędy, zanim urosną w siłę i staną się niebezpieczne.”

A niecały tydzień później podpisał oświadczenie straszące „zagładą spowodowaną AI”.

To wszystko może się wydawać dziwne, dopóki nie uświadomimy sobie, że szef OpenAI nie jest jakimś filozoficznym technologicznym geniuszem. Jest po prostu sprzedawcą. Kolejnym „Januszem tech-biznesu”.

OpenAI, Google i Microsoft zapędziły się w pewnym sensie w kozi róg. Próbując — poprzez promowanie i poleganie na gigantycznych modelach językowych — za jednym zamachem wyciąć konkurencję, a jednocześnie przywiązać osoby i firmy korzystające z tych narzędzi do siebie, nie doceniły tego, jak skuteczne i użyteczne mogą być modele znacznie mniejsze.

Starają się teraz tak sterować debatą publiczną i pracami nad regulacjami w obszarze „sztucznej inteligencji”, by uniemożliwić lub przynajmniej utrudnić tworzenie rozwiązań mniejszych, zwłaszcza tworzonych w modelu otwartego oprogramowania.